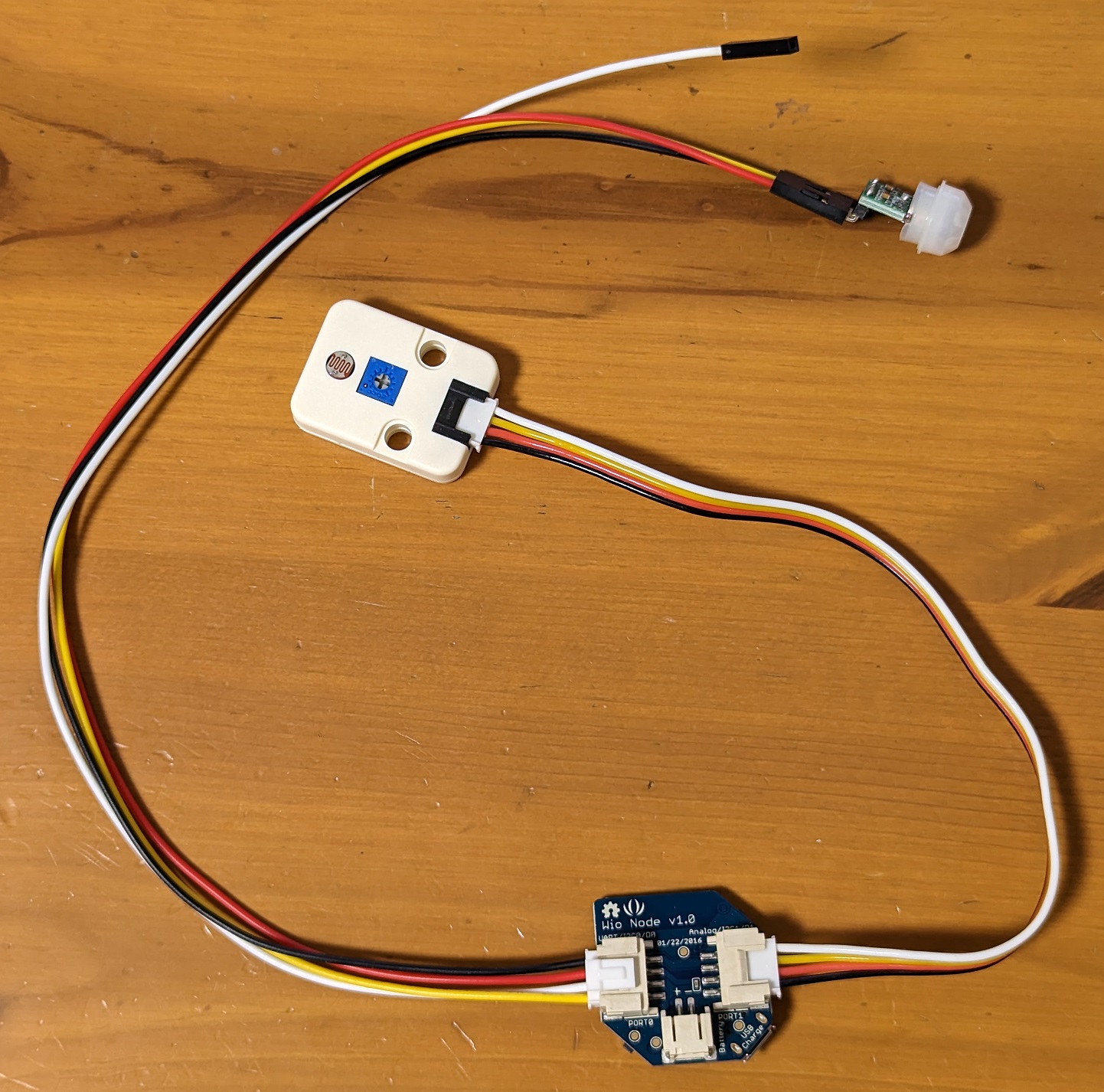

人感センサ (人の動きを感知するセンサ)

付であることに魅力を感じて IoT な学習リモコン

Nature Remo を買ったら、

人の動きをトリガーにした IFTTT との連携ができないばかりか、

センサの感度もあまりよくなかった。

仕方ないので人感センサを新たに買ってみた。

人感センサとしての感度は、

だんぜんこの

+Style ORIGINAL スマートセンサー(人感) PS-SMT-W01 のほうがいい。

IFTTT と連携できないので他の

IoT 機器との連携を考えている場合は注意が必要だが、

私は IFTTT をショートカットするので無問題。

思わず買い増ししてしまった。

Nature Remo から人感センサを引き算したら、

残りは「学習リモコン」ということになるが、

そこで思い出したのが

13年前に買ったパソコン用学習リモコン PC-OP-RS1。

いま流行りの IoT では無いが、

サーバが置いてある部屋で使うのであれば IoT である必要はなく、

むしろ PC-OP-RS1 のように (ネットを介さず) USB で直接コントロールできるほうが、

赤外線を発射するまでの遅延が少なくてすむ。

学習リモコン PC-OP-RS1 と人感センサ PS-SMT-W01 を組合わせれば

Nature Remo は不要?

と思ったので押し入れの中から PC-OP-RS1 を発掘した。

ところが、

家電のリモコンの赤外線を学習させようと、

PC-OP-RS1 の受光部に向けて赤外線を発射しても、

PC-OP-RS1 側では何も受け取っていない様子。

10年くらい使ってなかったから赤外線受光素子が劣化してしまったのか?

赤外線の受光はできないものの、

発光は可能みたい。

13年前に書いた

Perl スクリプトを使って

Nature Remo に向けて赤外線を発射してみると、

ちゃんと Nature Remo で波形データを生成できた。

ということは、

波形データさえ用意できれば今でも使えそう。

ただし、

13年前に PC-OP-RS1 を買ったときは、

波形データのフォーマットを知らなくても使えたので、

単に PC-OP-RS1 が出力した波形データを

16進数の羅列として perl スクリプトに取り込んだだけ。

当時書いた「日記」からスクリプト (の冒頭部分) を引用:

#!/usr/bin/perl

use strict;

use warnings;

use Device::SerialPort;

use Getopt::Std;

my %Ir;

$Ir{'vPower'} = [

pack("H*", "ffffffffffffffffffffff0700000000007ef0831ff8c00f7e00003f00800ffc00003f00801f00c00700f00300f8c10f7c00003f00801f00e00700f0831f00c00f7ee0033ff8c10ffc00003ff00100fc00007e00001f00000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000"),

];

$Ir{'aPower'} = [

pack("H*", "ffffffff0f00000080ff000000fc030000f01fc07f000000fe01fc070000e03f000000ff01fe030000f01f000080ff00fe010000f80fe03f000000ff000000fc07f01fc03f000000ff01fc07f80fe03f807f00ff01fc03f80f0000c07f00ff00fe03f80fe01fc07f00ffffffff07000000c03f000000ff010000f80fe01f000000ff00fe030000f01f0000807f00ff010000f80f0000c03f80ff000000fc07f00f0000c07f000000fe03f807f01f000080ff00fe01fc07f00fe03f80ff00fe01fc070000e03f807f00ff01fc03f80fe03f80ffffffff01000000f01f0000000000000000000000000000000000feffff"),

];

...以下略 ...

スクリプト中

「vPower」

はビデオテープレコーダ (VTR) の電源をオン/オフする赤外線のデータ。

「aPower」

は (おそらく) エアコンのオン/オフ。

後に続く 16進数の羅列が赤外線の波形データ。

どちらの家電もすでに無く (VTR なんてすでに死語?)、

そのリモコンも捨ててしまった。

なのでこのスクリプトが (今でも) ちゃんと機能するかは確認のすべがない。

とりあえず vPower の 16進数を 2進数で表示してみる:

senri:~ $ perl -e 'print unpack("b*", pack("H*", "ffffffffffffffffffffff0700000000007ef0831ff8c00f7e00003f00800ffc00003f00801f00c00700f00300f8c10f7c00003f00801f00e00700f0831f00c00f7ee0033ff8c10ffc00003ff00100fc00007e00001f00000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000"))."\n"'

111111111111111111111111111111111111111111111111111111111111111111111111111111111111111111100000000000000000000000000000000000000000000001111110000011111100000111111000000111110000001111110000011111100000000000000000111111000000000000000001111100000011111100000000000000001111110000000000000000011111100000000000000000111110000000000000000011111100000000000000000111111000001111110000001111100000000000000000111111000000000000000001111110000000000000000111111000000000000000001111110000011111100000000000000000111111000001111110000001111100000011111100000111111000001111110000001111110000000000000000111111000000111110000000000000000011111100000000000000000111111000000000000000001111100000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000000

おお、

(なんとなく ^^;) 赤外線の波形データっぽい。

2進数で表示すると、

最初の 91個の「1」と続く 46個の「0」の連続を除けば、

「1」は 5〜6個続くのに対し、

「0」は 5〜6個か、15〜17個続く。

これは赤外線リモコンの通信フォーマットにおける

1T (5〜6個) および 3T (15〜17個) の区間に対応するのだろう。

ということは T (変調単位) は 2進数 5.5個くらいに対応する、

つまり 2進数 1個は 100μ秒くらいなのだろう。

ちなみに unpack("B*", ...) (descending bit order) も試してみたのだが、

「"b*"」(ascending bit order) のほうが赤外線の波形データっぽかったので、

「"b*"」と仮定して作業を進めた。

とりあえず 2進数に変換してみる、みたいな試行錯誤を

1行スクリプトでサクっと書けてしまえるのは perl ならでは。

さいきんあまり人気がない perl だが、

この手の試行錯誤をするときには今でも一番ではなかろうか?

いっぽう Nature Remo の赤外線波形データはこんな感じ:

senri:~ $ curl -i -X GET "http://Remo-XXXXXX.local/messages" -H "Accept: application/json" -H "X-Requested-With: curl" -H "Expect: "

HTTP/1.0 200 OK

Server: Remo/1.0.77-g808448c

Content-Type: application/json

{"format":"us","freq":37,"data":[3357,1717,385,1305,377,468,386,460,386,460,387,459,383,463,385,462,382,463,383,463,383,462,384,465,381,465,379,1306,386,463,382,460,385,465,381,467,381,459,385,462,384,462,377,1312,386,1309,384,459,387,462,382,460,386,460,385,461,385,462,385,1306,385,461,384,1307,384,461,386,1306,402,1291,399,1291,382,1307,388,456,404,1290,401,443,403,1287,407,440,402,445,401,443,386,462,400,445,384,463,382,464,381,464,384,1306,401,1292,383,1302,409,1285,402,1289,383,1309,383,1306,387,1304,379,1312,407,1285,402,443,405,441,386,460,403,443,385,460,404,442,385,464,403,440,404,1289,405,1285,404,1282,388,1304,409,1282,390,1301,406,441,386,1306,407,436,410,441,401,440,406,443,385,1304,407,1284,404,1287,405,441,386,1305,408,1287,404,1285,385,1304,407,441,383,462,389,40199,3376,1697,384,1306,407,441,402,442,407,440,384,465,400,443,405,442,383,460,385,464,384,461,401,445,402,441,404,1291,400,446,384,461,400,446,381,463,383,466,399,444,402,444,383,1304,407,1287,401,444,384,460,404,442,407,439,406,442,403,441,404,1287,386,460,403,1289,400,445,403,1287,407,1282,409,1285,385,1307,400,444,405,1285,404,442,404,1289,402,442,405,441,401,444,386,459,404,442,405,441,403,443,404,442,407,1286,405,1288,398,1286,406,1285,409,1283,404,1287,407,1286,401,1294,406,1284,401,1288,401,446,381,462,402,445,401,444,402,444,384,462,383,466,398,442,407,1286,401,1288,403,1288,404,1288,403,1288,401,1290,407,439,404,1284,406,441,404,441,409,436,408,439,407,1285,406,1285,403,1289,400,446,402,1288,403,1287,405,1284,404,1286,409,437,406,444,404,39760,3379,1697,402,1288,404,442,405,441,401,444,407,439,406,441,401,446,402,441,407,439,402,445,406,441,401,443,401,1290,405,437,404,446,405,441,402,441,402,442,406,441,403,441,404,1290,402,1290,400,446,404,439,407,439,406,439,404,442,404,442,406,1288,401,442,402,1290,385,462,401,1289,401,1290,404,1288,399,1288,404,441,386,1306,402,446,402,1287,403,446,401,442,402,444,401,445,404,441,402,444,402,444,402,446,400,1290,398,1290,402,1287,385,1309,404,1287,400,1289,403,1292,401,1283,390,1302,387,1304,404,445,384,460,408,436,405,442,385,462,402,443,404,441,404,442,385,1306,404,1287,402,1292,383,1307,401,1289,404,1290,400,443,405,1282,388,461,406,439,404,446,384,461,383,1303,404,1289,385,1303,405,442,404,1288,405,1286,404,1287,402,1290,403,442,406,440,405]}

Nature Remo に向けて赤外線を発射した後、

http でアクセスすれば JSON 形式で波形データを返してくれる。

で、この波形データの意味は? と思う間もなく答が見つかってしまった。

つまんない。

data配列の各要素は、赤外線ONの期間、OFFの期間、ONの期間、OFFの期間、、、、を表している。 厳密には、これは38kHzの変調をデコードしたあとの結果である。実際にはONの期間は38kHzの変調信号になっている。

ぱっと見 400前後の数値が多いなぁと思ったが、

1T 区間に対応するわけね、納得。

ざっと見た感じ

「赤外線ONの期間」

のほうが

「OFFの期間」

より短めになっている感じがしたので、

前者は 85 で割り算し、

後者は 115 で割り算してみた。

この「商」(割り算した結果) の個数だけ 2進数の 1 と 0 を並べ、

16進数に変換すればオシマイ。

Nature Remo 形式から PC-OP-RS1 形式への変換スクリプト:

#!/usr/bin/perl

use strict;

use warnings;

my @data = (3357,1717,385,1305,377,468,386,460,386,460,387,459,383,463,385,462,382,463,383,463,383,462,384,465,381,465,379,1306,386,463,382,460,385,465,381,467,381,459,385,462,384,462,377,1312,386,1309,384,459,387,462,382,460,386,460,385,461,385,462,385,1306,385,461,384,1307,384,461,386,1306,402,1291,399,1291,382,1307,388,456,404,1290,401,443,403,1287,407,440,402,445,401,443,386,462,400,445,384,463,382,464,381,464,384,1306,401,1292,383,1302,409,1285,402,1289,383,1309,383,1306,387,1304,379,1312,407,1285,402,443,405,441,386,460,403,443,385,460,404,442,385,464,403,440,404,1289,405,1285,404,1282,388,1304,409,1282,390,1301,406,441,386,1306,407,436,410,441,401,440,406,443,385,1304,407,1284,404,1287,405,441,386,1305,408,1287,404,1285,385,1304,407,441,383,462,389,40199,3376,1697,384,1306,407,441,402,442,407,440,384,465,400,443,405,442,383,460,385,464,384,461,401,445,402,441,404,1291,400,446,384,461,400,446,381,463,383,466,399,444,402,444,383,1304,407,1287,401,444,384,460,404,442,407,439,406,442,403,441,404,1287,386,460,403,1289,400,445,403,1287,407,1282,409,1285,385,1307,400,444,405,1285,404,442,404,1289,402,442,405,441,401,444,386,459,404,442,405,441,403,443,404,442,407,1286,405,1288,398,1286,406,1285,409,1283,404,1287,407,1286,401,1294,406,1284,401,1288,401,446,381,462,402,445,401,444,402,444,384,462,383,466,398,442,407,1286,401,1288,403,1288,404,1288,403,1288,401,1290,407,439,404,1284,406,441,404,441,409,436,408,439,407,1285,406,1285,403,1289,400,446,402,1288,403,1287,405,1284,404,1286,409,437,406,444,404,39760,3379,1697,402,1288,404,442,405,441,401,444,407,439,406,441,401,446,402,441,407,439,402,445,406,441,401,443,401,1290,405,437,404,446,405,441,402,441,402,442,406,441,403,441,404,1290,402,1290,400,446,404,439,407,439,406,439,404,442,404,442,406,1288,401,442,402,1290,385,462,401,1289,401,1290,404,1288,399,1288,404,441,386,1306,402,446,402,1287,403,446,401,442,402,444,401,445,404,441,402,444,402,444,402,446,400,1290,398,1290,402,1287,385,1309,404,1287,400,1289,403,1292,401,1283,390,1302,387,1304,404,445,384,460,408,436,405,442,385,462,402,443,404,441,404,442,385,1306,404,1287,402,1292,383,1307,401,1289,404,1290,400,443,405,1282,388,461,406,439,404,446,384,461,383,1303,404,1289,385,1303,405,442,404,1288,405,1286,404,1287,402,1290,403,442,406,440,405);

my $str = "";

my $bit = 1;

for my $d (@data) {

if ($bit) {

$str .= $bit x ($d / 85);

$bit = 0;

} else {

$str .= $bit x ($d / 115);

$bit = 1;

}

}

$str = unpack("H*", pack("b*", $str)). "\n";

print "$str\n";

1行スクリプトに書けなくもないが、

まあ無理に 1行にしなくても、

このくらいならソッコーで書ける。

やっぱり perl が一番 :-)。

実行してみると ↓ こんな感じ。

波形データを PC-OP-RS1 形式に変換して初めて気付いたが、

80個以上の 0 が連なる区間

(2進数だと 320個以上、つまり 32ミリ秒以上の空白) があり、

3つの波形データに分けられることが分かる。

senri:~ $ ./irconv.pl

ffffffff7f00e001f0f0f0f07878787878787878003c3c3c3c3c1e1e1e000f80c7c3c3c3c3c303e0e101f0f00078003c001e008f07c0e301f0783c1e1e0f0f0f0f8007c003e001f00078003c001e000f8007c0e3f1f078783c3c1e000f8007c003e001f000783c001e8fc7e301f00078003c1e000f8007c003e0f1f000000000000000000000000000000000000000000000000000000000000000000000000000000000000000e0ffffffff0f003c001e8fc7c3e3f1f0f0f0783c001e0f8f8787c7e301f000783c3c1e8fc703e0e101f078003c001e000f80c703e0f100783c1e8fc7e3f178003c001e000f8007c003e001f00078003c001e0f8fc7e3e1e1f10078003c001e000f8007c0e301f0783c1e0f8007c003e0f10078003c001e008fc703000000000000000000000000000000000000000000000000000000000000000000000000000000000000f8ffffffff03000f80c7e3f1783c1e8fc7e3f100783c1e8fc7e3f10078003c1e8fc7e3f100783c001e1e000f8007c003e0f100783c001e8fc7e3f1783c1e000f8007c003e001f00078003c001e000f80c7c3e3f1f0783c1e000f8007c003e001f000783c001e1e8f8707c003e001f078003c001e000f80c7e301

というわけで、

上記「変換スクリプト」をちょこっと書き直して、

赤外線信号が表現しているデータを表示するようにしてみる。

NECフォーマットでも、

家製協(AEHA, 家電製品協会)フォーマットでも、

赤外線OFFの期間が 1T のとき「0」で、

3T のとき「1」だから、

赤外線ONの期間は無視して、

赤外線OFFの期間が 1000以上の時は 1 で、以下なら 0、

そして 3000以上なら信号の切れ目。

Nature Remo 形式から家製協(AEHA)フォーマットへの変換スクリプト:

#!/usr/bin/perl

use strict;

use warnings;

my @data = (3357,1717,385,1305,377,468,386,460,386,460,387,459,383,463,385,462,382,463,383,463,383,462,384,465,381,465,379,1306,386,463,382,460,385,465,381,467,381,459,385,462,384,462,377,1312,386,1309,384,459,387,462,382,460,386,460,385,461,385,462,385,1306,385,461,384,1307,384,461,386,1306,402,1291,399,1291,382,1307,388,456,404,1290,401,443,403,1287,407,440,402,445,401,443,386,462,400,445,384,463,382,464,381,464,384,1306,401,1292,383,1302,409,1285,402,1289,383,1309,383,1306,387,1304,379,1312,407,1285,402,443,405,441,386,460,403,443,385,460,404,442,385,464,403,440,404,1289,405,1285,404,1282,388,1304,409,1282,390,1301,406,441,386,1306,407,436,410,441,401,440,406,443,385,1304,407,1284,404,1287,405,441,386,1305,408,1287,404,1285,385,1304,407,441,383,462,389,40199,3376,1697,384,1306,407,441,402,442,407,440,384,465,400,443,405,442,383,460,385,464,384,461,401,445,402,441,404,1291,400,446,384,461,400,446,381,463,383,466,399,444,402,444,383,1304,407,1287,401,444,384,460,404,442,407,439,406,442,403,441,404,1287,386,460,403,1289,400,445,403,1287,407,1282,409,1285,385,1307,400,444,405,1285,404,442,404,1289,402,442,405,441,401,444,386,459,404,442,405,441,403,443,404,442,407,1286,405,1288,398,1286,406,1285,409,1283,404,1287,407,1286,401,1294,406,1284,401,1288,401,446,381,462,402,445,401,444,402,444,384,462,383,466,398,442,407,1286,401,1288,403,1288,404,1288,403,1288,401,1290,407,439,404,1284,406,441,404,441,409,436,408,439,407,1285,406,1285,403,1289,400,446,402,1288,403,1287,405,1284,404,1286,409,437,406,444,404,39760,3379,1697,402,1288,404,442,405,441,401,444,407,439,406,441,401,446,402,441,407,439,402,445,406,441,401,443,401,1290,405,437,404,446,405,441,402,441,402,442,406,441,403,441,404,1290,402,1290,400,446,404,439,407,439,406,439,404,442,404,442,406,1288,401,442,402,1290,385,462,401,1289,401,1290,404,1288,399,1288,404,441,386,1306,402,446,402,1287,403,446,401,442,402,444,401,445,404,441,402,444,402,444,402,446,400,1290,398,1290,402,1287,385,1309,404,1287,400,1289,403,1292,401,1283,390,1302,387,1304,404,445,384,460,408,436,405,442,385,462,402,443,404,441,404,442,385,1306,404,1287,402,1292,383,1307,401,1289,404,1290,400,443,405,1282,388,461,406,439,404,446,384,461,383,1303,404,1289,385,1303,405,442,404,1288,405,1286,404,1287,402,1290,403,442,406,440,405);

my $str = "";

my $bit = 1;

my $skip = 2;

for my $d (@data) {

next if $skip-- > 0;

if ($bit) {

$bit = 0;

} else {

if ($d > 3000) {

print unpack("h*", pack("b*", $str)). "\n";

$str = "";

$skip = 2;

} elsif ($d > 1000) {

$str .= "1";

} else {

$str .= "0";

}

$bit = 1;

}

}

print unpack("h*", pack("b*", $str)). "\n";

実行結果を以下に示す。

3つの波形は同じデータ

「10010305fa00ff30cf2cd3」(低 nybble が先)

の繰り返しだった。

前掲した PC-OP-RS1 形式への変換スクリプトで得た波形データは

454バイトもあったが、

3つの波形が同じなら最初の 1波形

124バイトだけでよいことになる。

PC-OP-RS1 は一度に送ることができる赤外線データが

240バイトという制限があるので、

1波形のみ送ることにした。

senri:~ $ ./iraeha.pl

10010305fa00ff30cf2cd3

10010305fa00ff30cf2cd3

10010305fa00ff30cf2cd3

以下は、

PC-OP-RS1 で赤外線の送信を行うスクリプト。

-d オプションで PC-OP-RS1 のデバイスを指定する。

受光部分が壊れてしまったので、赤外線を学習する機能はない。

前述したような方法 (Nature Remo 等の学習リモコンで元データを生成して変換)

で赤外線の波形データを作成し、

連想配列 %Ir に設定する。

緊張しながらこのスクリプトを実行 「./pc-op-rs1 -d /dev/PC-OP-RS1 off」

すると...

みごと 日立LED照明器具 LEC-AHS810K

が消灯した。

ということは日立製作所のメーカ識別コードが

0x1001 ってこと?

どこかに家製協のメーカ識別コード (カスタマーコード) の一覧って無いだろうか?

ちなみに「全灯」ボタンは「10010305fa00ff20df2cd3」だった。

#!/usr/bin/perl

use strict;

use warnings;

use Getopt::Std;

use Device::SerialPort;

my %Ir;

$Ir{'on'} = pack("H480", "ffffffff7f00e001f0f0783c1e8fc7e3f1783c001e1e8fc7e3f178003c001e1e8fc7e3f100783c001e1e000f8007c003e0e101f0f00078783c1e8fc7e3f10078003c001e000f8007c003e001f078003c1e0f8fc7c303e0e101f00078003c001e000f80c703e0e1e1f1f00078003c001e1e000f8007c003e0e1f1");

$Ir{'off'} = pack("H480", "ffffffff7f00e001f0f0f0f07878787878787878003c3c3c3c3c1e1e1e000f80c7c3c3c3c3c303e0e101f0f00078003c001e008f07c0e301f0783c1e1e0f0f0f0f8007c003e001f00078003c001e000f8007c0e3f1f078783c3c1e000f8007c003e001f000783c001e8fc7e301f00078003c1e000f8007c003e0f1f0");

our ($opt_v, $opt_d, $opt_c);

getopts("vd:c:") || help();

defined $opt_d || die "option -d is needed\n";

my $port = new Device::SerialPort($opt_d) || help();

$port->user_msg(1);

$port->error_msg(1);

$port->baudrate(115200);

$port->databits(8);

$port->parity("none");

$port->stopbits(1);

$port->handshake("none");

$port->read_const_time(100); # 0.1 sec

$port->read_char_time(5);

send_ir($port, "\x69");

recv_ir($port, 1, 3);

my $ch = 1;

if ($opt_c) {

if ($opt_c =~ /^[1-4]$/) {

$ch = $opt_c;

} else {

help();

}

}

while ($_ = shift @ARGV) {

defined $Ir{$_} || help();

send_ir($port, "\x74")

&& recv_ir($port, 1, 3) eq "\x59"

&& send_ir($port, pack("C", 0x30+$ch))

&& recv_ir($port, 1, 3) eq "\x59"

&& send_ir($port, $Ir{$_})

&& recv_ir($port, 1, 3) eq "\x45"

&& next;

die;

}

$port->close;

exit 0;

sub send_ir {

my ($port, $data) = @_;

$port->write($data);

print STDERR "send: ", unpack("H*", $data), "\n" if $opt_v;

}

sub recv_ir {

my ($port, $len, $timeout) = @_;

my $i = 0;

my $j = 0;

my $data;

while ($i < $len) {

my ($l, $d) = $port->read(1);

if ($l > 0) {

$data .= $d;

$i += $l;

$j = 0;

} else {

$j++;

if ($timeout > 0 && $j > $timeout) {

print STDERR "TIMEOUT to read $len byte\n";

return "";

}

}

}

print STDERR "recv: ", unpack("H*", $data), "\n" if $opt_v;

return $data;

}

sub help {

print STDERR <<EOF;

Usage: pc-op-rs1 [opt] <com>...

opt: -d <dev> device (MUST)

-c <ch> channel (1..4)

-v verbose

EOF

print "com: ", join(" ", sort keys %Ir), "\n";

exit 1;

}